Dans ce tutoriel, nous allons vous montrer comment installer Apache Hadoop sur CentOS 8. Pour ceux d'entre vous qui ne le savaient pas, Apache Hadoop est un framework open-source utilisé pour le stockage distribué comme ainsi que le traitement distribué des mégadonnées sur des grappes d'ordinateurs qui s'exécutent sur du matériel de base. Plutôt que de s'appuyer sur du matériel pour offrir une haute disponibilité, la bibliothèque elle-même est conçue pour détecter et gérer les pannes au niveau de la couche application, offrant ainsi un service hautement disponible sur sommet d'un cluster d'ordinateurs, chacun pouvant être sujet à des pannes.

Cet article suppose que vous avez au moins des connaissances de base sur Linux, que vous savez utiliser le shell et, plus important encore, que vous hébergez votre site sur votre propre VPS. L'installation est assez simple et suppose que vous s'exécutent dans le compte root, sinon vous devrez peut-être ajouter 'sudo ‘ aux commandes pour obtenir les privilèges root. Je vais vous montrer l'installation pas à pas d'Apache Hadoop sur un serveur CentOS 8.

Prérequis

- Un serveur exécutant l'un des systèmes d'exploitation suivants :CentOS 8.

- Il est recommandé d'utiliser une nouvelle installation du système d'exploitation pour éviter tout problème potentiel.

- Accès SSH au serveur (ou ouvrez simplement Terminal si vous êtes sur un ordinateur).

- Un

non-root sudo userou l'accès à l'root user. Nous vous recommandons d'agir en tant qu'non-root sudo user, cependant, car vous pouvez endommager votre système si vous ne faites pas attention lorsque vous agissez en tant que root.

Installer Apache Hadoop sur CentOS 8

Étape 1. Tout d'abord, commençons par nous assurer que votre système est à jour.

sudo dnf update

Étape 2. Installation de Java.

Apache Hadoop est écrit en Java et ne prend en charge que la version 8 de Java. Vous pouvez installer OpenJDK 8 à l'aide de la commande suivante :

sudo dnf install java-1.8.0-openjdk ant

Vérifiez la version Java :

java -version

Étape 3. Installation d'Apache Hadoop CentOS 8.

Il est recommandé de créer un utilisateur normal pour configurer Apache Hadoop, créez un utilisateur à l'aide de la commande suivante :

useradd hadoop passwd hadoop

Ensuite, nous devrons configurer l'authentification SSH sans mot de passe pour le système local :

su - hadoop ssh-keygen -t rsa cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys chmod 640 ~/.ssh/authorized_keys

Vérifiez la configuration ssh sans mot de passe avec la commande :

ssh localhost

Étapes suivantes, téléchargez la dernière version stable d'Apache Hadoop, Au moment de la rédaction de cet article, il s'agit de la version 3.2.1 :

wget http://apachemirror.wuchna.com/hadoop/common/hadoop-3.2.1/hadoop-3.2.1.tar.gz tar -xvzf hadoop-3.2.1.tar.gz mv hadoop-3.2.1 hadoop

Ensuite, vous devrez configurer les variables d'environnement Hadoop et Java sur votre système :

nano ~/.bashrc

export JAVA_HOME=/usr/lib/jvm/jre-1.8.0-openjdk-1.8.0.232.b09-2.el8_1.x86_64/ export HADOOP_HOME=/home/hadoop/hadoop export HADOOP_INSTALL=$HADOOP_HOME export HADOOP_MAPRED_HOME=$HADOOP_HOME export HADOOP_COMMON_HOME=$HADOOP_HOME export HADOOP_HDFS_HOME=$HADOOP_HOME export HADOOP_YARN_HOME=$HADOOP_HOME export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native export PATH=$PATH:$HADOOP_HOME/sbin:$HADOOP_HOME/bin export HADOOP_OPTS="-Djava.library.path=$HADOOP_HOME/lib/native"

Nous activons maintenant les variables d'environnement avec la commande suivante :

source ~/.bashrc

Ensuite, ouvrez le fichier de variables d'environnement Hadoop :

nano $HADOOP_HOME/etc/hadoop/hadoop-env.sh

export JAVA_HOME=/usr/lib/jvm/jre-1.8.0-openjdk-1.8.0.232.b09-2.el8_1.x86_64/

Hadoop possède de nombreux fichiers de configuration, qui doivent être configurés selon les exigences de votre infrastructure Hadoop. Commençons par la configuration avec une configuration de cluster à nœud unique Hadoop de base :

cd $HADOOP_HOME/etc/hadoop

Modifier core-site.xml :

<configuration> <property> <name>fs.default.name</name> <value>hdfs://localhost:9000</value> </property> </configuration>

Créez les répertoires namenode et datanode sous hadoop user home /home/hadoop répertoire :

mkdir -p ~/hadoopdata/hdfs/{namenode,datanode} Modifier hdfs-site.xml :

<configuration> <property> <name>dfs.replication</name> <value>1</value> </property> <property> <name>dfs.name.dir</name> <value>file:///home/hadoop/hadoopdata/hdfs/namenode</value> </property> <property> <name>dfs.data.dir</name> <value>file:///home/hadoop/hadoopdata/hdfs/datanode</value> </property> </configuration>

Modifier mapred-site.xml :

<configuration> <property> <name>mapreduce.framework.name</name> <value>yarn</value> </property> </configuration>

Modifier Yarn-site.xml :

<configuration> <property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property> </configuration>

Formatez maintenant namenode à l'aide de la commande suivante, n'oubliez pas de vérifier le répertoire de stockage :

hdfs namenode -format

Démarrez les démons NameNode et DataNode en utilisant les scripts fournis par Hadoop :

start-dfs.sh

Étape 4. Configurez le pare-feu.

Exécutez la commande suivante pour autoriser les connexions Apache Hadoop via le pare-feu :

firewall-cmd --permanent --add-port=9870/tcp firewall-cmd --permanent --add-port=8088/tcp firewall-cmd --reload

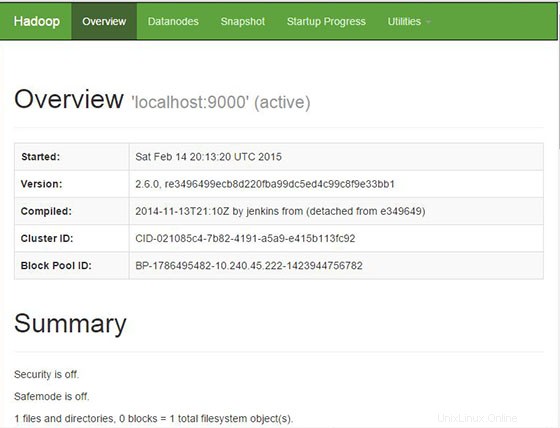

Étape 5. Accéder à Apache Hadoop.

Apache Hadoop sera disponible sur le port HTTP 9870 et le port 50070 par défaut. Ouvrez votre navigateur préféré et accédez à http://your-domain.com:9870 ou http://your-server-ip:9870 .

Félicitations ! Vous avez installé Apache Hadoop avec succès. Merci d'avoir utilisé ce didacticiel pour installer Hadoop sur le système CentOS 8. Pour obtenir de l'aide supplémentaire ou des informations utiles, nous vous recommandons de consulter le site Web officiel d'Apache Hadoop.